Introduzione: L’immaginario di un futuro in cui i pensieri umani sono verbalizzati attraverso una sorta di interfaccia esterna porta con sé interrogativi sulla privacy individuale e sulla libertà di scelta. Questa prospettiva inquietante suscita un’attenta riflessione sulle normative e sulle linee guida necessarie per regolamentare queste tecnologie che possono avere un utilizzo benefico. Va sottolineato infatti il potenziale positivo di queste tecnologie, in particolare nel supporto a individui affetti da gravi patologie neurologiche, come la sindrome di Locked-in, per migliorare la loro comunicazione e interazione con il mondo esterno.

Esperimenti sull’attività cerebrale: La ricerca scientifica condotta da vari studiosi, come il professor John Smith dell’Università di Cambridge e il dottor Maria Garcia presso il Max Planck Institute, ha aperto la strada a un approfondimento delle complesse attività cerebrali. Questi scienziati hanno utilizzato tecniche come l’elettroencefalografia (EEG) e la risonanza magnetica funzionale (fMRI) su primati e partecipanti umani per mappare le regioni cerebrali coinvolte nei processi decisionali, emotivi e motori, aprendo nuove prospettive sul funzionamento del cervello.

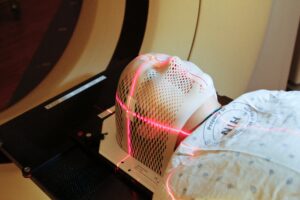

Interfaccia cervello-computer: La ricerca sull’interfaccia cervello-computer ha rappresentato una pietra miliare nella neuroscienza. Il dottor Carlos Rodriguez dell’Università di Stanford ha studiato l’optogenetica, manipolando i circuiti cerebrali nei topi per impiantare immagini artificiali. Questa ricerca ha aperto prospettive sulla manipolazione delle esperienze sensoriali attraverso il controllo diretto di specifici circuiti cerebrali. Nel frattempo, il professor Emily Johnson di Harvard ha sviluppato un dispositivo che consente ai partecipanti umani di controllare uno schermo attraverso l’attività cerebrale, aprendo nuove vie di comunicazione per le persone con disabilità gravi.

Percorsi prudenti a tutela delle persone: Huth e Tang, esperti nella decodifica cerebrale, hanno evidenziato la caratteristica non invasiva dell’interfaccia cervello-computer, attraverso caschi esterni, questo la rende più accessibile, ma allo stesso tempo suscettibile a usi impropri. In Cina, ad esempio, sono stati riscontrati casi di dispositivi EEG utilizzati in ambito educativo e lavorativo (nel 2018 e nel 2019) per monitorare e controllare le attività degli studenti e dei dipendenti, sollevando preoccupazioni etiche riguardo alla privacy e al controllo individuale. La loro riflessione etica, ispirata da studi come quelli condotti dal Morningside Group (su “Nature”, 2017) e dal gruppo di Stephen Rainay ( su “Science and Engineering”, 2020), ha messo in evidenza l’importanza di evitare pratiche come la decodifica senza consenso o in stati di riposo, enfatizzando la necessità di normative chiare e di consapevolezza etica. I dati cerebrali sono chiaramente dati altamente sensibili perché possono contenere informazioni che un soggetto potrebbe non voler esternare, ma che potrebbero tuttavia diventare accessibili ad altri, in situazioni specifiche utilizzando la neurotecnologia.

Questioni etico-legali: Le neurotecnologie attuali, come le interfacce cervello-computer (BCI), hanno applicazioni terapeutiche, come aiutare persone con lesioni al midollo spinale a compiere compiti motori semplici. Tuttavia, il potenziale futuro di queste tecnologie solleva importanti questioni etiche legate a privacy, identità, autonomia ed equità. Nell’autunno del 2017, Rafael Yuste, Sara Goering hanno convocato un incontro al Morningside Campus della Columbia, invitando quasi 30 esperti provenienti da tutto il mondo nei campi della neurotecnologia, intelligenza artificiale, etica medica e legge. “Ci siamo rifugiati per tre giorni per studiare le conseguenze etiche e sociali della neurotecnologia”, ha detto Yuste. “E siamo giunti alla conclusione che questa è una questione di diritti umani. Questi metodi saranno così potenti, in grado di accedere e manipolare l’attività mentale, e devono essere regolamentati secondo la prospettiva dei diritti umani. È in quel momento che abbiamo coniato il termine ‘neurorights'”. I lavori del convegno sono stati pubblicati su Nature (2017). Rafael Yuste ha messo in luce l’importanza di tutelare la privacy mentale, il libero arbitrio e l’accesso equo alle tecnologie.

Figure come Guido Girardi, politico cileno, e Jared Genser, avvocato internazionale per i diritti umani, si impegnano attivamente per promuovere una tutela legale dei neurodiritti a livello globale, cercando di garantire l’integrità e la dignità individuale nell’utilizzo delle BCIs e delle neurotecnologie avanzate. Genser sottolinea l’importanza di coinvolgere organizzazioni internazionali come le Nazioni Unite e altri enti governativi e non governativi per affrontare le sfide etiche e legali sollevate dalle tecnologie neurologiche emergenti. La sua visione è quella di estendere l’interpretazione delle attuali leggi internazionali sui diritti umani per includere specifiche tutele per la privacy mentale, senza necessariamente ricorrere alla creazione di nuovi trattati o convenzioni. Questo approccio potrebbe accelerare il riconoscimento e la tutela dei neurodiritti a livello globale, adattando i percorsi legali alle dinamiche più rapide delle tecnologie emergenti.

Cinque neurodiritti: Già nel lavoro curato dal neuroscienziato Yuste, pubblicato su Nature (2017) si sono delineati questi ‘neurodiritti’ che sono i punti fermi della riflessione etico-giuridica:

- Diritto alla privacy mentale: Garantire che i dati cerebrali siano trattati con riservatezza e siano soggetti a rigorose regolamentazioni riguardo all’uso, alla vendita e al trasferimento commerciale.

- Diritto all’identità personale: Limitare le tecnologie che potrebbero compromettere il senso di sé individuale.

- Diritto all’accesso equo al potenziamento mentale: Garantire l’uguaglianza nell’accesso alle neurotecnologie per migliorare le capacità mentali.

- Protezione dall’incorporazione di pregiudizi negli algoritmi delle neurotecnologie: Evitare che gli algoritmi utilizzati creino discriminazioni.

- Diritto all’autonomia: Proteggere l’autonomia individuale dall’essere manipolata da neurotecnologie esterne.

Né scatole aperte, né marionette: Da un lato, i neurodiritti seguono il solco antico della difesa della persona come unica, speciale e libera, con un’integrità da tutelare (non siamo scatole aperte). Dall’altro, si integrano in una realtà in cui la tecnologia è parte della nostra “natura personale”, orientata verso gli obiettivi di benessere che scegliamo liberamente (non siamo marionette). Al di là di scenari distopici, l’interfaccia cervello-computer può costituire un valido strumento di comunicazione e realizzazione.

Riferimenti:

Asilomar AI Principles, August 11, 2017 (https://futureoflife.org/open-letter/ai-principles/)

R. Yuste et al., Four ethical priorities for neurotechnologies and AI, in “Nature”, 2017, vol. 551, pp. 159–163 (https://www.nature.com/articles/551159a)

S. Rainey, Brain Recording, Mind-Reading, and Neurotechnology: Ethical Issues from Consumer Devices to Brain-Based Speech Decoding, in “Science and Engineering Ethics”, 2020, vol. 26, pp. 2295–2311 (https://link.springer.com/article/10.1007/s11948-020-00218-0)

F. Reveley, Advances in Mind-Decoding Technologies Raise Hopes (and Worries), in “Undark”, Jan 3rd, 2024 (https://undark.org/2024/01/03/brain-computer-neurorights/?mc_cid=011ca9af69&mc_eid=2c1b9ac713)